隨著人工智能技術(shù)的迅猛發(fā)展和廣泛應(yīng)用,其帶來的安全、倫理與治理挑戰(zhàn)日益凸顯。一個(gè)健全、前瞻的人工智能安全治理體系,已成為確保技術(shù)健康、可持續(xù)、負(fù)責(zé)任發(fā)展的關(guān)鍵。在這一體系中,基礎(chǔ)軟件開發(fā)作為整個(gè)AI技術(shù)棧的基石,其安全性與可靠性直接決定了上層應(yīng)用乃至整個(gè)生態(tài)的穩(wěn)健程度。因此,構(gòu)建一個(gè)以基礎(chǔ)軟件為核心的人工智能安全一體化治理框架,具有至關(guān)重要的戰(zhàn)略意義。

一、 框架的核心目標(biāo)與原則

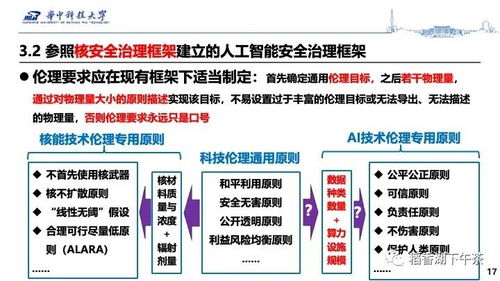

人工智能安全一體化治理框架的核心目標(biāo),是在促進(jìn)技術(shù)創(chuàng)新的系統(tǒng)性地識(shí)別、評估、防范和應(yīng)對AI全生命周期中的各類風(fēng)險(xiǎn),確保AI系統(tǒng)的安全性、可靠性、公平性、可解釋性及隱私保護(hù)。圍繞基礎(chǔ)軟件開發(fā),該框架遵循以下核心原則:

- 安全與可信原則: 將安全與可信設(shè)計(jì)(Security and Trust by Design)內(nèi)嵌于基礎(chǔ)軟件的架構(gòu)、編碼、測試和部署全流程,而非事后補(bǔ)救。

- 責(zé)任共擔(dān)原則: 明確基礎(chǔ)軟件開發(fā)者、開源社區(qū)、集成商、部署方及最終用戶等各方的安全責(zé)任與義務(wù),形成協(xié)同治理合力。

- 透明與可審計(jì)原則: 提升基礎(chǔ)軟件(特別是核心算法庫、框架)的透明度,建立代碼、數(shù)據(jù)流向、模型行為的可審計(jì)機(jī)制。

- 動(dòng)態(tài)適應(yīng)原則: 治理框架需具備足夠的靈活性和適應(yīng)性,能夠跟上AI技術(shù)的快速迭代和新型威脅的演變。

- 隱私與數(shù)據(jù)安全原則: 在基礎(chǔ)軟件層面強(qiáng)化數(shù)據(jù)訪問控制、加密、脫敏和生命周期管理能力。

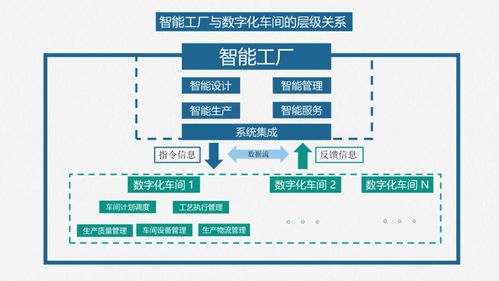

二、 圍繞基礎(chǔ)軟件開發(fā)的一體化治理層級

該框架可構(gòu)建為自上而下、層層遞進(jìn)的四個(gè)治理層級,共同作用于AI基礎(chǔ)軟件的開發(fā)與運(yùn)營。

第一層:戰(zhàn)略與法規(guī)層

此層為框架提供頂層設(shè)計(jì)與合規(guī)依據(jù)。包括:

- 國家與行業(yè)戰(zhàn)略: 制定AI安全發(fā)展的國家戰(zhàn)略,明確基礎(chǔ)軟件安全的優(yōu)先方向和支持政策。

- 法律法規(guī)與標(biāo)準(zhǔn): 出臺(tái)針對AI基礎(chǔ)軟件安全、開源合規(guī)、供應(yīng)鏈安全的法律法規(guī)。推動(dòng)建立涵蓋代碼安全、數(shù)據(jù)安全、模型安全、接口安全的行業(yè)與技術(shù)標(biāo)準(zhǔn)體系。

- 倫理準(zhǔn)則: 將公平、非歧視、可控等倫理要求轉(zhuǎn)化為基礎(chǔ)軟件開發(fā)的約束性指標(biāo)。

第二層:組織與流程層

此層將戰(zhàn)略與法規(guī)要求轉(zhuǎn)化為具體開發(fā)實(shí)踐。包括:

- 安全開發(fā)生命周期(SDLC for AI): 為AI基礎(chǔ)軟件開發(fā)定制安全開發(fā)生命周期,在需求分析、設(shè)計(jì)、編碼、測試、發(fā)布、維護(hù)各階段嵌入安全檢查點(diǎn)。

- 供應(yīng)鏈安全管理: 建立對第三方庫、開源組件、預(yù)訓(xùn)練模型的嚴(yán)格引入審核、持續(xù)監(jiān)控和漏洞響應(yīng)機(jī)制,繪制軟件物料清單(SBOM)。

- 漏洞管理與應(yīng)急響應(yīng): 建立專門針對AI基礎(chǔ)軟件(如框架漏洞、算法后門、數(shù)據(jù)污染)的漏洞披露、評估、修復(fù)和應(yīng)急響應(yīng)流程與團(tuán)隊(duì)。

- 開發(fā)者教育與認(rèn)證: 對基礎(chǔ)軟件開發(fā)者進(jìn)行AI安全專項(xiàng)培訓(xùn)與能力認(rèn)證,提升整體安全開發(fā)意識(shí)與技能。

第三層:技術(shù)與工具層

此層提供實(shí)現(xiàn)安全目標(biāo)的具體技術(shù)手段與工具鏈。包括:

- 安全編碼與審計(jì)工具: 集成適用于AI代碼(如Python, CUDA)的靜態(tài)/動(dòng)態(tài)代碼分析工具,檢測安全漏洞與不良模式。

- 數(shù)據(jù)安全與隱私增強(qiáng)技術(shù)(PETs): 在基礎(chǔ)軟件中集成差分隱私、聯(lián)邦學(xué)習(xí)、同態(tài)加密等技術(shù)的底層支持,實(shí)現(xiàn)數(shù)據(jù)“可用不可見”。

- 模型安全測試工具: 開發(fā)用于測試基礎(chǔ)模型及算法魯棒性(對抗攻擊)、公平性、可解釋性的專用工具包。

- 可信執(zhí)行環(huán)境(TEE): 在硬件和基礎(chǔ)軟件層面支持TEE,保障關(guān)鍵代碼與數(shù)據(jù)在運(yùn)行時(shí)的機(jī)密性和完整性。

- 監(jiān)控與可觀測性工具: 在基礎(chǔ)軟件中內(nèi)置運(yùn)行時(shí)行為監(jiān)控、日志審計(jì)和異常檢測能力。

第四層:驗(yàn)證與監(jiān)督層

此層確保治理措施的有效性和持續(xù)性。包括:

- 安全測評與認(rèn)證: 建立獨(dú)立的第三方AI基礎(chǔ)軟件安全測評體系,開展安全等級認(rèn)證。

- 持續(xù)合規(guī)監(jiān)控: 利用自動(dòng)化工具對已部署的基礎(chǔ)軟件進(jìn)行持續(xù)合規(guī)性檢查與風(fēng)險(xiǎn)掃描。

- 審計(jì)與問責(zé)機(jī)制: 定期對基礎(chǔ)軟件開發(fā)流程、供應(yīng)鏈、安全事件進(jìn)行內(nèi)部與外部審計(jì),并建立清晰的責(zé)任追溯與問責(zé)機(jī)制。

- 社區(qū)與行業(yè)共治: 鼓勵(lì)開源社區(qū)建立安全治理規(guī)范,通過行業(yè)聯(lián)盟共享威脅情報(bào)和最佳實(shí)踐。

三、 關(guān)鍵實(shí)施路徑

- 優(yōu)先領(lǐng)域突破: 首先聚焦于應(yīng)用最廣泛、風(fēng)險(xiǎn)最集中的基礎(chǔ)軟件領(lǐng)域,如深度學(xué)習(xí)框架(TensorFlow, PyTorch等)、大規(guī)模預(yù)訓(xùn)練模型基礎(chǔ)庫、關(guān)鍵AI編譯器與運(yùn)行時(shí),率先建立治理示范。

- 產(chǎn)學(xué)研用協(xié)同: 聯(lián)合頂尖學(xué)術(shù)機(jī)構(gòu)、領(lǐng)先科技企業(yè)、開源社區(qū)和關(guān)鍵行業(yè)用戶,共同研發(fā)治理技術(shù)、制定標(biāo)準(zhǔn)、開展試點(diǎn)。

- 國際對話與合作: 積極參與全球AI安全治理對話,在基礎(chǔ)軟件安全標(biāo)準(zhǔn)、漏洞披露、倫理準(zhǔn)則等方面尋求國際共識(shí)與合作,應(yīng)對跨國性風(fēng)險(xiǎn)。

- 迭代優(yōu)化: 治理框架本身應(yīng)作為一個(gè)“活”的系統(tǒng),根據(jù)技術(shù)發(fā)展、威脅態(tài)勢和實(shí)踐反饋進(jìn)行定期評估與迭代更新。

結(jié)論

人工智能安全一體化治理是一項(xiàng)復(fù)雜而緊迫的系統(tǒng)工程。將治理的關(guān)口前移,牢牢抓住基礎(chǔ)軟件開發(fā)這一源頭環(huán)節(jié),構(gòu)建涵蓋戰(zhàn)略、組織、技術(shù)、監(jiān)督的多層次治理框架,是筑牢AI安全防線的根本之策。只有確保“地基”的堅(jiān)實(shí)與可信,才能支撐起人工智能這座宏偉大廈的穩(wěn)定、繁榮與向善發(fā)展,真正釋放其造福社會(huì)的巨大潛能。

DeepMind 人工智能設(shè)計(jì)出比人類快 70% 的排序算法,或?qū)⒅厮苋蜍浖阅芨?/span>

DeepMind 人工智能設(shè)計(jì)出比人類快 70% 的排序算法,或?qū)⒅厮苋蜍浖阅芨?/span>